اپل با اسکن تصاویر آپلود شده در آیکلاد، با سواستفاده از کودکان مبارزه میکند

اپل مدتی است پروژهای در جهت مبارزه با کودک آزاری و جلوگیری از سوء استفاده از کودکان را دنبال میکند که از طریق اسکن کردن تصاویر کاربران قبل از آپلود روی آیکلاد، میتواند موارد نامناسب را تشخیص داده و در صورت نیاز نهادهای قضایی و اجرایی را باخبر کند. هرچند این موضوع باعث نگرانی برخی نهادهای حافظ حقوق کاربران شده است.

در این پروژه جدید که شامل نصب اپلیکیشنهای پیشفرض در سیستم عاملهای iOS و iPadOS میشود، اپل سعی دارد انتشار محتوای مستهجن مرتبط با کودکان را محدود کرده و در عین حال از حریم شخصی کاربران حفاظت کند.

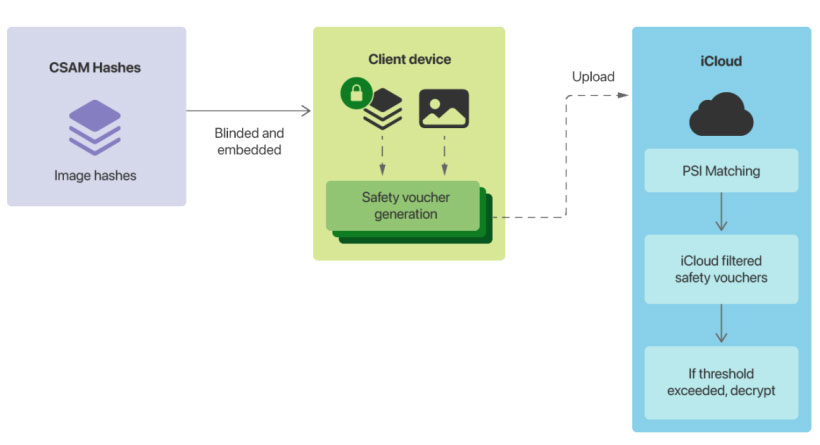

دستگاههای عرضه شده از سال آینده در بازار آمریکا دارای چنین اپهایی خواهند بود. جزئیات پروژه گفته شده در صفحه مرتبط با حفاظت از کودکان در وب سایت اپل نیز مورد اشاره قرار گرفته است. یکی از قابلیتهای مرتبط با این پروژه، اسکن کردن تصاویر حافظه داخلی دستگاه قبل از تهیه نسخه پشتیبان از آنها روی آیکلاد است که جنجالهای بسیاری را به دنبال داشته است. اپل ادعا دارد که اسکن تصاویر پیش از اقدام به آپلود فایل روی فضای ابری، صورت نخواهد گرفت و تنها در صورتی که تصاویر حساب کاربری از معیارهای در نظر گرفته شده عبور کند، گزارش به اپل ارسال میشود.

اپل برای سالیان طولانی از سیستم هش برای شناسایی تصاویر کودک آزاری در فایلهای الصاق شده به ایمیلها استفاده کرده است. همچنین سایر پلتفرمها از جمله جیمیل نیز فناوریهای مشابهی جهت یافتن محتواهای مستهجن را بکار گرفتهاند. پروژه جدید اپل میتواند نمونهای همسان را به سرویس iCloud Photos اضافه کند؛ حتی اگر تصاویر برای کاربر دیگری ارسال نشوند.

در فایل PDF منتشر شده از سوی اپل، تعدادی از قوانین مرتبط با پروژه مذکور شرح داده شده است که بیشتر در جهت رعایت حریم شخصی کاربران تنظیم شدهاند و برخی از موارد مهم گفته شده از سوی اپل شامل گزارههای زیر میشوند:

اپل نمیتواند هیچ اطلاعاتی از تصاویری که با معیارهای پایگاه داده CSAM همخوانی ندارند، کسب کند. اگر تصویری با معیارهای گفته شده همخوانی داشته باشد، اپل نمیتواند به اطلاعات آن از جمله متا دیتا و جزئیات بصری دسترسی داشته باشد مگر اینکه تعداد دفعات تکرار رخداد برای یک حساب کاربری از حد مجاز عبور کند. احتمال شناسایی موارد کاذب توسط سیستم بسیار پایین است؛ اما اپل برای اطمینان از صحت و دقت گزارشها، اقدام به بررسی دستی آنها میکند. کاربران نمیتوانند به پایگاه داده مورد استفاده برای شناسایی تصاویر مستهجن کودکان دسترسی داشته باشند. کاربران متوجه نخواهند شد که کدام تصاویر توسط سیستم به عنوان فایل نامناسب شناخته شده است.

اپل سعی کرده است با ایجاد ساختاری پلکانی، از اعلام هشدار کاذب برای حسابهای کاربری جلوگیری کند که مهمترین آنها، در نظر گرفتن حد مجاز گزارشها برای هر اکانت است. اگر یک حساب کاربری توسط سیستم شناسایی شود، گزارش قبل از ارسال به نهادهای قضایی و قانونی، توسط اپل مورد بازرسی قرار میگیرد که میتواند میزان دقت سیستم را به صورت چشمگیری افزایش دهد.

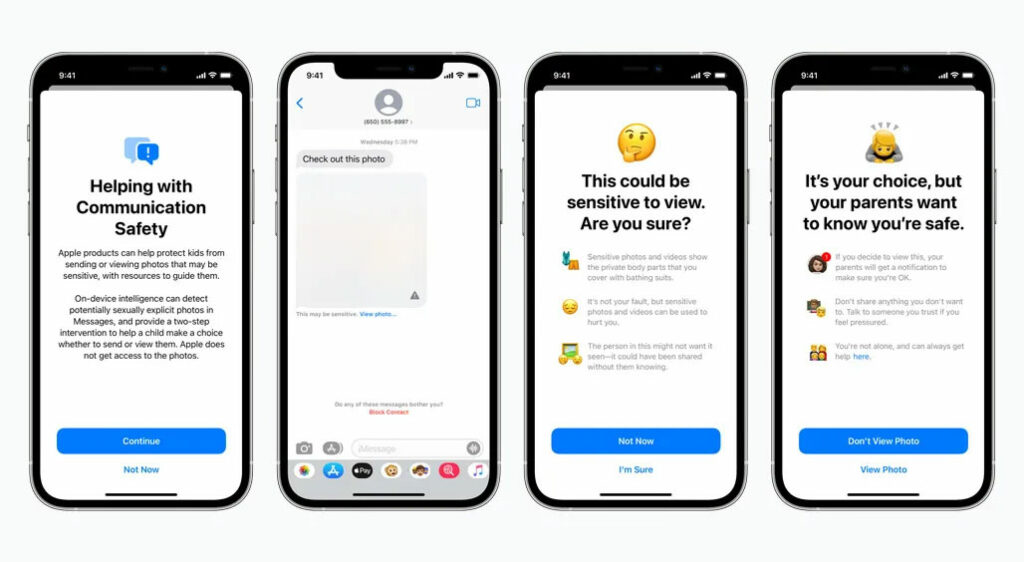

اقدامات تازهای نیز برای حفاظت از نوجوانان صاحب آیفون از سوی اپل در نظر گرفته شده است که میتواند احتمال سوء استفاده از آنها را کاهش دهد. اپلیکیشن Messages در گذشته اقدام به اسکن تصاویر ضمیمه شده به پیامها میکرد و در صورت یافتن مورد نامناسب، آن را به صورت محو همراه با یک هشدار نمایش میداد. اکنون والدین میتوانند به لطف امکان جدیدی در حساب کاربری خانوادگی آیکلاد، از دریافت یا ارسال چنین تصاویری توسط فرزندان خود، مطلع شوند. نحوه عکس العمل سیری و اپلیکیشن Search نیز به موارد مرتبط با سوء استفاده از کودکان بهبود پیدا کرده است و پیرامون معایب و عواقب احتمالی چنین رفتاری به افراد هشدار میدهد.